【新唐人北京时间2024年08月04日讯】欧盟制定的《人工智慧法》已于8月正式生效,并将于2026年全面实施。近年来,与AI相关的深度伪造和语音合成技术被用于犯罪,AI诈骗案件呈现爆炸式增长,受害者遍布全球且不少人因此倾家荡产。

上述法律是全球第一个与AI相关的大型法律,宗旨是解决AI的负面影响、制定全面的监管框架,规范企业在AI方面的开发、使用和应用方式。

该立法对不同的AI采用四个等级的风险制度。关键基础设施、教育或职业培训及医疗等方面的AI应用,皆被视为“高风险”。这些高风险的AI应用,需要严格遵守监管、安全、稳定和准确性等重要义务。

另外,该法律要求“有限风险”的AI开发商要有公开透明的义务,要让使用者知道与他们对话的是AI,还是真人。若向公众通报公共利益问题时,需要标注是否使用AI,该项规则也适用于“深伪技术和语音合成内容”。

虽然该法律对于其它2个低等级风险的AI应用要求不这么严格,但这些AI也要受到当局的市场监督,且厂商要对AI程序自行监督和建立监控系统,若发生严重事件或故障,皆需要向当局进行“报告”。

若违反该法律的公司,最高可能会被处以750万欧元(约960万美元)到3500万欧元(约3780万美元)或全球年收入1.5%到7%(以较高金额为准)的罚款。

AI相关诈骗案频传

欧盟的《人工智慧法》可以说是用来应对AI在性能大幅度提升后所衍生的诈骗、黑客、假讯息等问题。另外,现实世界中与AI相关的犯罪案件,也正在不断增加当中。

信用卡支付巨头Visa在7月底披露,越来越多不肖人士利用AI的能力,生成信用卡上的主卡号(16位数字或19位数字),并利用其算力进行快速持续测试直到破解主卡号、卡片背后的安全码(CVV)、到期日期和获得批准回应。

他们还提醒,现在许多爱情骗局、投资骗局、杀猪盘等骗局,都在使用AI进行诈骗。另外,Visa在今年3月提出一份威胁报告就曾提到,在2022年10月至2023年9月间,公司阻止了共400亿美元的诈欺活动,该数据几乎是一年前的两倍。

目前与AI相关的著名网路诈骗案件,莫过于英国伦敦的会计师杨海伦(Helen Young,音译)被假的中共警察诈骗了29,000英镑(约37,000美元),而这些歹徒正是利用了海外华人对中共的恐惧心理和极具欺骗性的AI画面达成目的。

海伦在7月初向媒体披露,一名假警察先是打视频电话给她,并利用AI技术向她展示逼真的警服、警察证件和功能齐全的警察局画面,随后指控海伦涉嫌参与一起大型金融诈骗案。

这名假警察还要求她接受调查、下载一个监控程序和签署一份保密协议,并警告她不许向外界透露调查,否则就有生命危险。不久后,海伦收到一段关于“嫌犯”向警方认罪并指控她是整个金融诈骗案的“主谋”的视频。

这段视频让她心生恐惧,于是向这名假警官支付29,000英镑的保释金,以避免自己被引渡回中国,原因是海伦当下认为她回到中国必死无疑。

几天后,假警察向她索要25万英镑(约32万美元)赎金,但这次海伦选择将事情告诉女儿,女儿则告诉她这是一场诈骗案件,并陪同她报案和去银行报告,幸运的是,她们最终要回这笔巨款。

不过其他人就没有像她那么幸运。据美国联邦调查局(FBI)连续两年发布有关于网路犯罪报告显示,2023年网路犯罪分子实施网路诈欺的频率和财务影响都出现创纪录增长。

FBI网路犯罪投诉中心(IC3)从民众那里收到88万起投诉,它们估计潜在损失超过 125亿美元,与2022年相比,投诉数量增加了近10%,损失增加22%。

FBI在报告中也提到,投资诈骗造成的犯罪损失最高,这些歹徒会利用虚假资讯,诱导投资者进行虚假的投资。2023年的投资诈欺损失已增至45.7亿美元,比2022年增长38%,其中是最常见的诈骗类型是网路钓鱼诈骗。

深伪技术和语音窃取技术成为犯罪利器

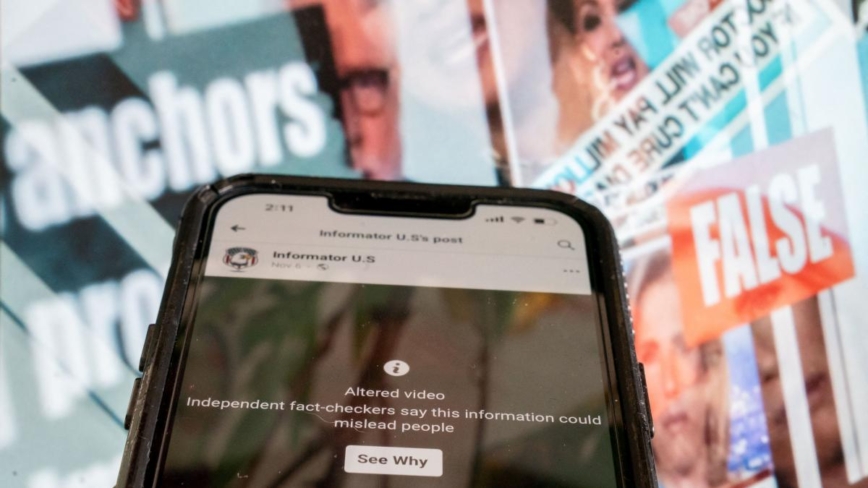

除了FBI提到的网路钓鱼诈骗之外,还有歹徒利用AI的深伪技术和声音窃取的方式,伪造名人影片进行虚假宣传,或制作虚假视讯通话进行敲诈勒索,可以说这些技术正在挑战我们对于现实的认知。

罗马尼亚网络安全技术公司Bitdefender在今年7月初发布了一项关于犯罪分子使用AI中的深伪技术进行“虚假药物宣传”的报告,并揭露犯罪分子是如何用AI,将相当常见的骗局提升到新水平。

报告中提到,歹徒利用深伪制作一些知名医生、电视主持人和医疗保健专业人士为不存在的“灵丹妙药”进行虚假代言和背书,并将这些欺骗影片散播到Facebook、Instagram等社群媒体平台。

这些虚假广告中的人物形象和声音都十分逼真,甚至可以做出眨眼、微笑等细微表情,许多罹患癌症、慢性病甚至不治之症的患者信以为真,去购买这些药物,导致他们可能延误病情,甚至出现生命危险。另外,有人点击这些含有钓鱼性质的购买链接后,就会被窃取数据或清空资料。

报告还提到,歹徒还会利用那些被他们控制的社群媒体账号,去做更多的推广活动,使受害者人数不断地增加。

著名的英国医学杂志《BMJ》在7月中发表的一篇关于“深伪技术”的警示报告也提到,一些不肖人士利用深伪在社群媒体上散播一些虚假的药物的广告,而这种“深度赝品”也在日益增多,因为研究表明,将近一半的人无法真正区分出真品与赝品。

另外,英国工程公司奥雅纳(Arup)在5月的时候向媒体证实,他们公司的一名员工在2月因一通深度伪造的视讯通话,向犯罪分子发送了2,560万美元。

Visa首席风险和客户服务长保罗‧法巴拉(Paul Fabara)3月在该公司的半年威胁报告中表示,“随着生成式AI与其它新兴技术的使用,这些诈骗比以往任何时候都更具说服力,并给消费者带来前所未有的损失。”

美国身份和存取管理公司Okta在2024年1月就曾警告,网络犯罪分子只要利用AI,就能在三秒内克隆使用者的声音,并将这些声音用来诈骗其他人,让其以为这个声音是真实的。

日本的电脑工程师清原仁(Kiyohara jin)8月1日对大纪元表示,“尽管AI给人类带来诸多好处,但相关的犯罪也在逐年增多且有失控趋势。这些问题都是人的道德没有跟上导致的,只有人提升自身的道德,才能解决根本的问题。”

日本电子工程师荻野悟(Satoru Ogino)持相似的看法。他对大纪元表示,“目前所有问题的关键在于人心。另外,这些坏人利用普通人对亲人或名人的信任进行诈骗活动,将严重破坏人和人之间的信任,使人们之间的分歧变得更大。”

专家教你如何应对AI假消息

目前,真假难辨的AI诈骗可以说日益猖獗,人们除了需要提高警惕多方查证之外,还能做些什么呢?以下是专家和政府给的一些防范建议。

美国政府消费者和工人保护部(DCWP)告诉民众如何辨别AI相关的诈骗:寻找影片或视频电话中不正常抖动或不切实际的动作,观察光线或肤色的变化、眨眼(人物可能都不眨眼)及眼睛周围的阴影。

除此之外,还可以倾听声音和影像不一致的地方,或说话者是否做了一些不符合他性格的举动,例如索取你的钱或个人资讯。因为这些经过AI深伪的影片,有时会存在奇怪的字词选择、生硬的语言和断断续续的句子。

据弗吉尼亚州社会媒体theroanokestar.com报导,弗吉尼亚理工大学(VT)图书馆员兼数位素养教育家朱莉娅‧费拉尔(Julia Feerrar)表示,“识别错误讯息(无论是否由人工智慧产生)最有效的方法之一就是,查看它的来源,并观看正规的yabo88官网媒体。如果你有点不确定消息来源,可以通过多方面搜索去验证消息。”

她说,“这种方式称为横向阅读,就是对内容本身进行更多搜索,去查证自己阅读的内容是否正确,同时可以查看其它值得信赖的yabo88官网媒体是否报导了您所看到的相同标题。”

清原仁也提出自己的建议。他说,“由于目前AI还无法回答跨度大或过于复杂的问题,我们可以利用这点去检测对方是真人还是AI。另外,遇到事物先冷静思考和保持理智,抑制自身的冲动之后,再对得到的消息进行经过多方面验证,这样做就能大概率避免掉这些诈骗。”

(记者张钟元、王佳宜对此文有贡献)

(转自大纪元/责任编辑:叶萍)